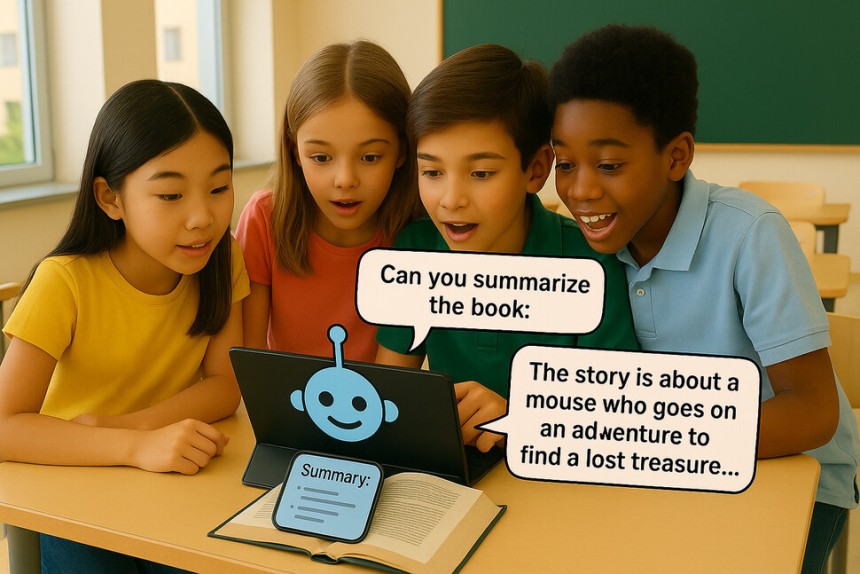

생성형 인공지능(AI) ‘퍼플렉시티’ 프로 버전에 “교실에서 초등학생들이 생성형 AI가 탑재된 태블릿을 통해 책 내용을 요약해달라고 요청하는 이미지’를 그려달라”고 지시어를 입력해서 생성한 이미지. 얼마 전 어린 학생들을 대상으로 진행한 강연에서 충격적인 이야기를 하나 들었다.

요즘 아이들은 책을 읽는 대신 인공지능(AI)을 사용해 만든 요약본을 읽는다는 것이다.

요약본조차 읽고 싶지 않을 땐 해당 내용을 쇼츠로 만들어서 볼 수도 있다고 아이는 자랑스럽게 말했다.

담임교사가 그 이야기를 들었다면 좀 슬펐겠지만(다행히 담임은 교실에 없었다), 사실 나는 학생들이 좀 대단하다고 생각했다.

AI에 도서 요약을 시키려면 직접 스캔을 하든 인터넷을 뒤지든 도서 피디에프(PDF) 파일을 확보해 AI에 제공해야 한다.

그 정도 열정이라면 그건 꾀를 부리는 정도를 넘어 저항정신이 아닌가. 물론 혹자는 아이들의 문해력을 걱정할지도 모르겠다.

하지만 여기서 필요한 질문은 이런 질문 같다.

AI가 정말로 사람이 이해하는 것처럼 글을 이해할 수 있을까? 나아가 인간이 직접 책을 읽는 행위는 앞으로도 의미가 있을까?

AI에 도서 내용 요약시키는 아이들

챗지피티(ChatGPT)로 대표되는 ‘요즘 AI’는 생성형 인공지능이다.

그전까지의 AI는 정답을 골랐지만, 생성형 AI는 학습된 데이터를 바탕으로 정답을 만들어낸다.

이런 일이 가능해진 이유는 2010년대 말 탄생한 대규모언어모델(LLM, Large Language Model) 덕분이다.

이름에서 알 수 있듯 놀랍도록 빠르게 똑똑해진 요즘 AI 능력의 근간에는 언어가 자리하고 있다.

그러나 이것이 컴퓨터가 정말로 인간처럼 언어를 사용하게 됐다는 뜻은 아니다.

컴퓨터는 여전히 0과 1의 세계에 살고 있고, AI는 자연어처리기술(NLP, Natural Language Processing)을 바탕으로 언어를 구사한다.

자연어처리기술에서 자연어란 우리가 일상적으로 사용하는 말을 뜻한다.

이를 자연어라 부르는 이유는 컴퓨터에 직접 명령을 내릴 때 사용하는 프로그래밍언어(기계어)와 구별하기 위해서다.

자연어처리기술은 두 언어 사이에 필요한 번역을 담당한다.

자연어처리기술은 크게 두 단계를 거쳐 문장을 기계어로 번역한다.

첫 번째 절차는 토큰화로 문장을 단어, 형태소 등 작은 단위(토큰)로 쪼개는 일이다.

토큰화가 완료된 문장은 두 번째 절차인 임베딩 단계를 거친다.

임베딩은 토큰을 컴퓨터가 이해할 수 있도록 고유한 벡터로 변환해 사전으로 만드는 작업이다.

여기서 벡터란 방향성을 가진 숫자로, (0, 1)같은 모종의 좌푯값이다.

좌푯값을 가진 단어들로 만들어진 사전은 마치 유의어-반의어 사전처럼 컴퓨터가 단어들 사이의 관계를 파악할 수 있도록 해준다.

예를 들어 ‘강아지’와 ‘고양이’ ‘사과’를 임베딩해보자. 강아지와 고양이에게는 모두 동물이라는 공통점이 있지만 사과는 과일이다.

이를 바탕으로 벡터를 부여하면 강아지는 (1, 1), 고양이는 (1, 2), 사과는 (2, 1) 같은 식으로 정리할 수 있다.

이렇게 숫자로 바꿔놓고 나면 이제 컴퓨터는 단어와 단어가 얼마나 가깝고 먼지를 뺄셈으로 계산할 수 있게 된다.

앞 예시에서 ‘동물’과 ‘과일’은 1의 거리를 가진 셈이고, 만약 ‘식물’이라는 다른 범주를 만들어 1.5로 저장한다면 ‘동물’과 ‘식물’ 사이의 거리는 0.5가 된다.

AI가 할 수 있는 것과 할 수 없는 것

대규모언어모델에 기반한 AI는 자연어 처리된 데이터를 대량으로 학습한 결과물이다.

앞서 예시로 살펴본 임베딩은 단순화된 버전이고, 실제로 AI를 학습시킬 때는 문장과 문장 사이의 관계, 문맥, 감정, 논리적 흐름까지도 파악할 수 있도록 충분히 큰 벡터값을 사용한다.

AI는 시, 소설, 백과사전, 신문 기사, 법률 등 인터넷에서 수집할 수 있는 모든 텍스트를 데이터 삼아 학습했다.

챗지피티 제조사인 오픈에이아이(OpenAI)에서 공개하기로는 그 과정에서 1750억 개의 관계를 파악했다고 한다.

이를 매개변수(parameter)라 하는데, 벡터의 방향이 그만큼 많았다고 이해하면 편하다.

여기서 중요한 점은 AI를 학습시켰다고 하는 것이 본질적으로 거대한 통계 작업이라는 사실이다.

AI는 한 단어가 다른 단어와 “어떠한 방향으로 멀고 가까운지”를 아주 잘 파악하고 있는 통계학자인 셈이다.

이는 인간이 언어를 이해한다고 하는 것과는 좀 다르다.

문장을 만들 때 우리는 언어를 이해하고 사용하지만, AI는 패턴과 확률에 따라 언어를 예측한다.

예를 들어 “나는 너를”이라는 값이 입력되면 AI는 다음에 올 말을 예측해 “사랑해”라는 말을 이어붙인다.

정말로 너를 사랑하지도 않으면서 말이다.

하지만 그저 통계학자라고만 보기에 작금의 AI는 너무 유능하다.

뉴스 기사를 작성할 뿐 아니라 수학능력시험도 풀고 과학 논문도 척척 내놓는다.

패턴을 파악할 뿐이라면 이렇게까지 할 수 있는가? 나는 이 질문이 거꾸로 된 질문이라고 생각한다.

내가 보기에 실상은 우리가 상기한 작업을 필요 이상으로 어렵다고 믿었던 것에 불과하다.

논문을 쓸 때 숨이 턱 막혔던 부분은 내용을 생성하는 것이 아니라 연구 주제를 잡고 가설을 설정하는 일이 아니었던가? 그 부분은 지금도 AI가 해결해주지 못한다.

다량의 데이터 파악이 필요하거나 형식이 까다로워서 어려웠던 일들을 해결하는 데 지금의 AI는 놀랍고도 뛰어난 성능을 발휘한다.

그것은 본질적으로 고도화된 패턴을 다루는 일이기 때문이다.

그러나 패턴을 넘어 무엇을 문제시해야 할지 결정하는 것은 전혀 다른 일이다.

AI가 대규모언어모델을 근간으로 하는 이상, 패턴 그 이상의 것이 필요한 고도의 작업은 여전히 인간의 영역으로 남겨져 있다.

정보 너머의 고유한 ‘경험’

처음의 문제로 돌아가보자. AI에 책을 대신 읽힌 다음 요약해달라고 할 때 우리는 무엇을 기대할 수 있을까? 잘 정리된 정보를 기대할 수 있다.

화자의 뉘앙스 역시 포착해줄 수 있고, 책에 대해 일반적으로 기대되는 평가를 해줄 수도 있다.

반대로 독자가 잃어버리는 것은 자기 자신이다.

텍스트를 읽는다는 것은 탄광에서 금을 캐는 일과는 다르다.

오히려 어릴 적 학교에서 하던 보물찾기와 비슷하다.

보물이 무엇인지, 얼마나 많은지, 애초에 있기는 한지 참여자는 보물을 찾아내기 전까지는 알 수 없다.

때로는 아무것도 발견하지 못했지만 재미있는 시간을 보낼 수도 있고, 선생이 숨겨놓은 보물이 아니라 나만의 비밀기지를 발견할 수도 있다.

그것은 패턴화된 요약으로는 발견될 수 없다.

오직 내 몸으로 경험해야만 도달할 수 있는 나만의 것이다.

그러니 뻔한 결론이긴 하지만 아마 독서가들은 앞으로도 직접 책을 읽을 것이다.

그게 우리의 놀이고 추억이고, 우리를 구성하는 일부니까. 서윤빈 소설가